年初にラスベガスで開催されたコンシューマー・エレクトロニクス・ショー(CES)2017では、アマゾンのAI技術が自動車や冷蔵庫などの多くの製品やサービスに搭載されたと報じられた。自動車や冷蔵庫がアマゾンのAIでコントロールされると思った人もいるだろう。しかし今のところ、SFに登場するような「万能な人工知能」は存在していない。

データの分析や予測を行うためのソフトウェアが、機械学習によってその精度や効率を飛躍的に高めることができるようになった。そのようなソフトウェアと、目や耳などの感覚器官の役割をするセンサーや、手や足の役割を果たすハードウェアとを組み合わせた「分野特化型の人工知能」が、工場の生産ラインや自動車の運転などで、これまで人間が行なっていた特定の作業や業務を自動化し始めている。人間の仕事を奪うかもしれないと話題になっているAIとは、この「分野特化型の人工知能」を指している。

一方で、機械学習によって精度や効率を高めた画像認識や音声認識などのソフトウェアは、インターネットサービスの画像検索や、音声によるスマートフォンの操作や、Eコマースの商品のおすすめなどにも応用されている。では、自動車や冷蔵庫に搭載されたアマゾンのAI技術とはどのようなものだろう。

アレクサの正体

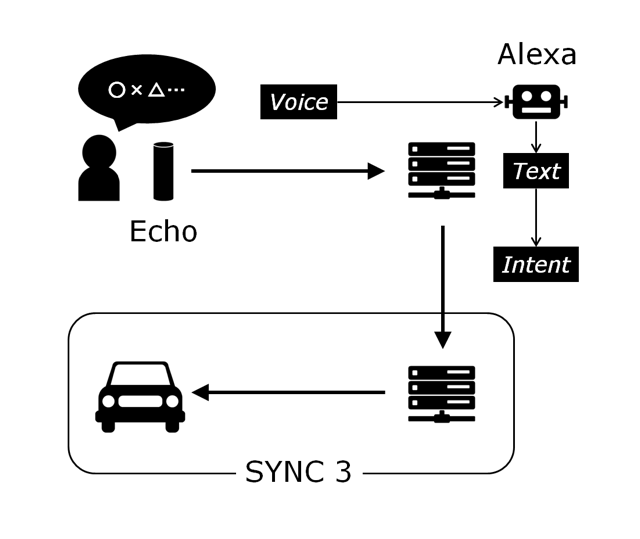

リビングなどに置かれたアマゾンのEchoという、マイクとスピーカーを備えた端末に向かって、例えば「車を始動しておいて」と話すと、その音声がインターネット上のサーバで動くソフトウェアによってテキストに変換され、そのテキストに該当するインテント(意図)と呼ばれる情報が「フォード」(昨年のCESで、フォードとアマゾンは提携を発表)のサーバに送られる。そして、その情報が自動車に送られてエンジンやモーターのスイッチが入るという仕組みだ。この流れの中で音声をテキストに変換(自動音声認識)し、さらにテキストが意味することを解析(自然言語認識)してインテントに変換するソフトウェアが、自動車に搭載されたというアマゾンのAI技術の正体だ。それを中心にした音声によるリクエストを仲介するシステムがAlexa(アレクサ)と呼ばれている。

さらにフォードはEchoと同様の機能を自動車に搭載する予定で、運転中に「レストランを予約して」とか「ガレージのシャッターを開けて」とAlexaにリクエストすることができるようになる。Alexaはリクエストをインテントに変換して、指定されたサードパーティーのサービスに転送する。サービスからの応答のテキストはAlexaが音声に変換して自動車に返され、画像データは車載のディスプレイに表示される。

すでにフォードは、スマートフォンで車を始動したりドアをロックしたり、運転中にオーディオやカーナビなどの操作をしたりする統合環境(SYNC 3)をオプションとして用意している。SYNC 3をAlexaに接続するだけで、それらの操作を音声で行うことができるようになるわけだ。リビングから車を起動したりドアをロックしたりするニーズがどれだけあるかはわからないが、運転中に視線をそらさずに、Alexaに何かをリクエストしたくなることは多いだろう。