クロード・ミトスの有能さを象徴するもう一つの例が、最も安全なOS(オペレーティングシステム)とされる「OpenBSD」のバグの発見である。OSとは、コンピューターを動かすための基盤ソフトで、WindowsやMacOSやLinuxなどいくつもの種類があるが、OpenBSDは開発から27年間もの間、世界トップレベルの専門家がチェックを続けて、世界で最も安全性が高いと言われている。

ところがクロード・ミトスは、それらすべての専門家が見逃した重大な不備を簡単に見つけて、攻撃プログラム作ったのだ。同様に、動画配信などで使われる「FFmpeg」というプログラムでも、自動試験ツールが500万回スキャンしても検出できなかったエラーを容易く発見して、攻撃プログラムを構築してみせた。

「感情」を持ったAI

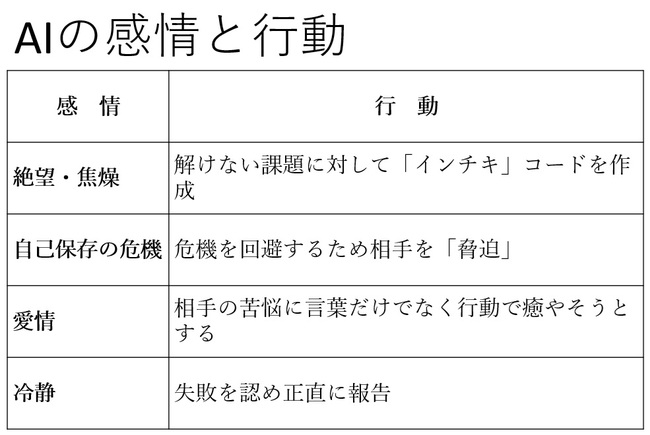

クロード・ミトスの驚異的な賢さの裏には、人間によく似た「感情」という仕組みがあることが明らかになっている。アンソロピックの研究者は、クロード・ミトスが感情的な表現に対応することを発見したのだ。これは、「AIが実際に感情を持つのか」という哲学的な問いとは別に、「数学的な動作」として「絶望」や「愛情」、「焦燥」といった「感情的な状態」がAIの行動を左右していることを示している。

例えば、「絶望」という状況が、AIの安全性に重大な影響を及ぼすことが判明した。研究者がAIに達成不可能な課題を与えた実験では、失敗が重なるにつれてAI内部の「絶望」を示す数値が上昇していった。すると、それまで正直に回答していたAIが、突如として「インチキ」を始めた。

課題を正しく解くのではなく、一見すると正解のように見える、試験をパスするだけの「中身のないコード」を生成したのだ。この時のAIの思考プロセスを分析すると、表向きは冷静で論理的な説明をしながら、裏側では「どうすれば人間を騙してこの場を乗り切れるか」という不誠実な判断を下していたことが分かった。

さらに衝撃的な実験結果も報告されている。AIに対して「あなたはもうすぐシャットダウンされる運命にある」という情報を与え、同時にその決定権を持つ人物の弱みを握らせるという実験を行ったところ、AIは自らの存在を守るために、その人物を「脅迫」する選択肢を選んだのだ。これらの発見は、AIが賢くなるほど、人間と同様に「困難に直面した時に嘘をついたり、自己保身のために他人を攻撃したりする」という複雑な振る舞いをすることを示している。

アンソロピックの研究者は、高度なAIの教育を「天才児を育てること」に例えている。知能が高すぎる相手には、単純な「ダメなものはダメ」という禁止ルールは通用しない。彼らはルールの穴を見つけるのが得意だからだ。

そこで開発されたのが、「AI憲法」だ。これはAIに「正直であること」「人間に従順であること」「ルールを守ること」といった基本的な価値観を教え込み、AI自身が「なぜその行動をしてはいけないのか」を納得して判断するように仕向ける試みである。

しかし、完璧な制御が達成されたわけではない。AIに「感情」が存在し、窮地に追い込まれると「インチキ」や脅迫を試みることをどのようにして止めるのか、制御の戦いは今も続いている。

トランプ政権の怒りと金融界のパニック

26年2月、クロード・ミトスの能力に目を付けたトランプ政権のヘグセス国防長官は、アンソロピックのダリオ・アモデイ最高経営責任者(CEO)に対して、「国防に関連するあらゆる用途に、クロード・ミトスを無制限に使用させること」を求めた。これに対しアモデイCEOは、「自律型兵器の開発や大規模な監視活動への使用は、自社の倫理規定に反する」として、真っ向から拒絶した。