5月8日の産経ニュース(デジタル)は「日本の電機大手がAIに本腰 課題は人材不足 技術者獲得競争過熱」と報じました。「フェイスブックやグーグルに勝つつもりで臨む」といった勇ましい言葉も紹介されていますが、各社のIR資料などを見ても、AIで勝つためのこれといった戦略は示されていないようです。

新しいテクノロジーが生まれたとき、メディアの過剰な煽りなどによって市場の期待が急激に高まることがあります。しかし、そのテクノロジーの未成熟さなどから、なかなか実際の製品やサービスとして実現されないと、その期待が一気に幻滅に変わってしまいます。そして、その中から成熟したものが生き残り、実際の製品やサービスとして市場に提供されてゆきます。この流れはハイプ・サイクルと呼ばれています。これまでに二度にわたって市場の期待を裏切ってきたAIは、いまハイプ・サイクルの三度目の頂点にあります。まさにAIへAIへと草木もなびいていますが、遅ればせの「日本の電機大手」に残された金脈はどこにあるのでしょうか。

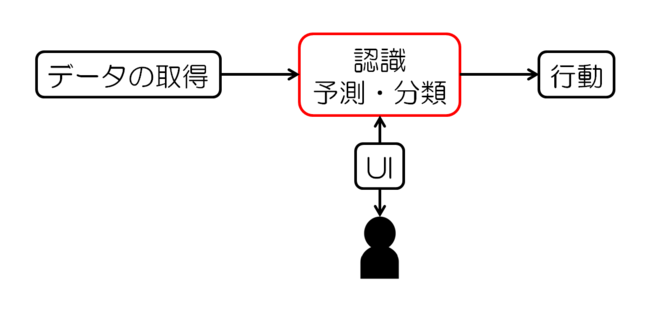

データを認識し予測や分類を行うAI

いま注目を集めているAIは、データを認識して予測や分類を行うソフトウェアで、次のようなモデルで利用されています。

自動運転車を例にとると、カメラやGPS、レーダーなどのセンサーといった「データの取得システム」が取得した画像などのデータが「認識と予測・分類のシステム」に送られ、そこでAIが認識し予測・分類した結果が自動車という「行動のシステム」に送られます。「行動のシステム」では、あらかじめ決められているアルゴリズムによって、対応するハンドルやアクセルやブレーキなどの操作(行動)が実行されます。これらの三つのシステムは、自動運転車のように一体化されていたり、それぞれIoTデバイスとクラウド、そして何らかのハードウェアに分散されていたりします。

アマゾンのEchoやグーグルのHomeなどの音声アシスタントと呼ばれるデバイス(UI)は、ユーザーの音声をクラウド上の「認識と予測・分類のシステム」に送り、そこで音声がテキストに変換(音声認識)され、さらにテキストが意味することが解析(自然言語認識)されて、その結果の命令や質問が「行動のシステム」に送られます。それが「行動のシステム」で処理され、応答のテキストが「認識と予測・分類のシステム」に返され、音声に変換されてから音声アシスタントに送られて再生されます。

このように、データを認識し予測や分類をするAIは、現時点では画像認識や音声認識や自然言語処理のソフトウェアだと考えてよいでしょう。特に画像認識のAIは、例えば金融の分野で、チャート(画像)の動きを監視して特定のパターンを検出して自動取引を行うシステムや、ショッピングモールなどでカメラ画像から人の流れや量を検出し、その年齢や性別などを推定してマーケティングに活用するシステムなどで広く活用され始めています。